NuEdgeWise : Machine learning development environment for Nuvoton AI

Nuvoton NuEdgeWise IDE 是由新唐科技推出專為 TinyML 開發的機器學習工具,支援機器學習應用開發的四個主要階段,包括標記、訓練、驗證和測試。

NuEdgeWise利用 Jupyter Notebook 提供平台,開發者可以在新唐的微控制器與微處理器上使用 TensorFlow Lite 進行模型的訓練和部署,使 TinyML 的應用變得更加輕鬆。

開發流程介紹:

|

步驟I |

|

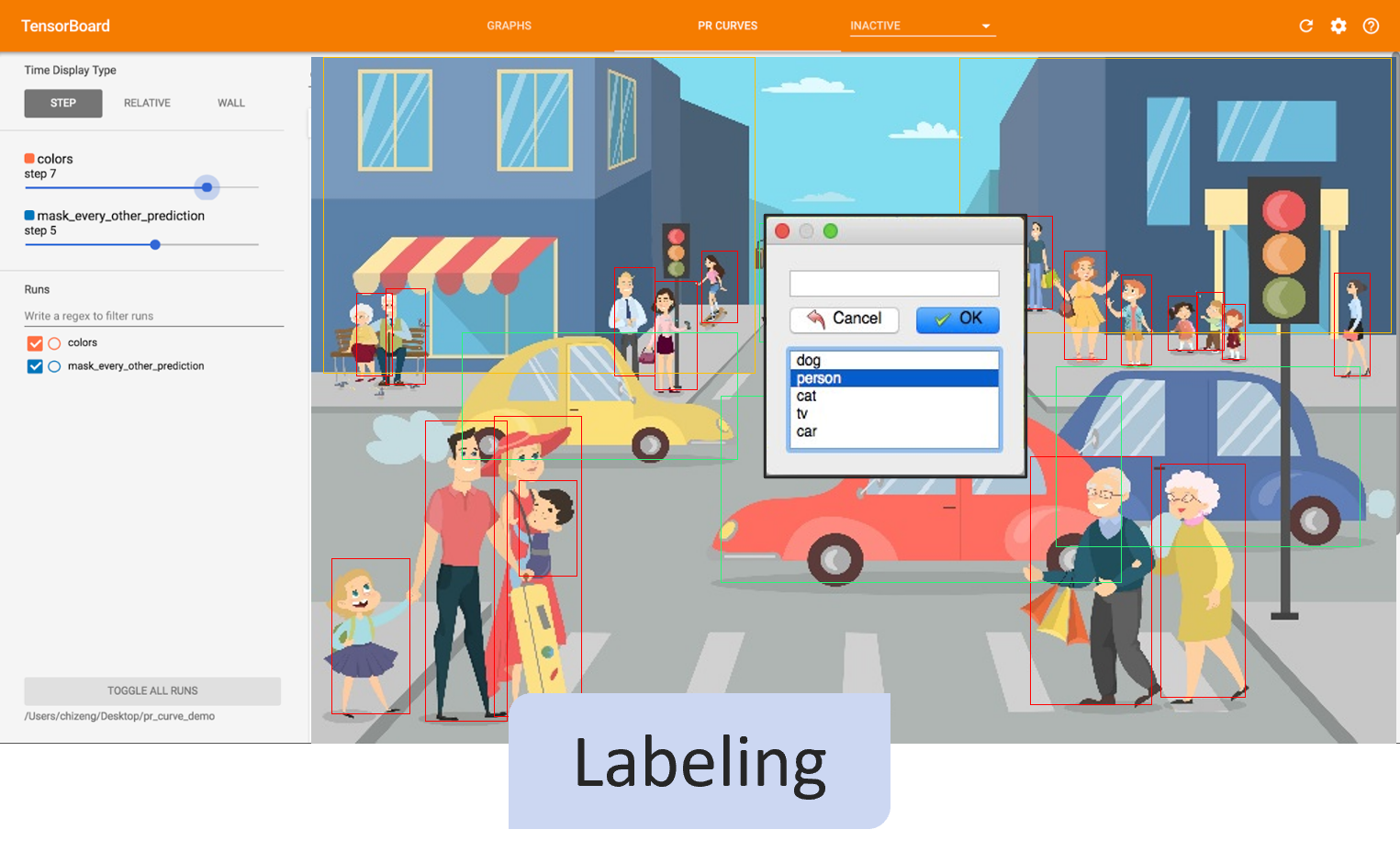

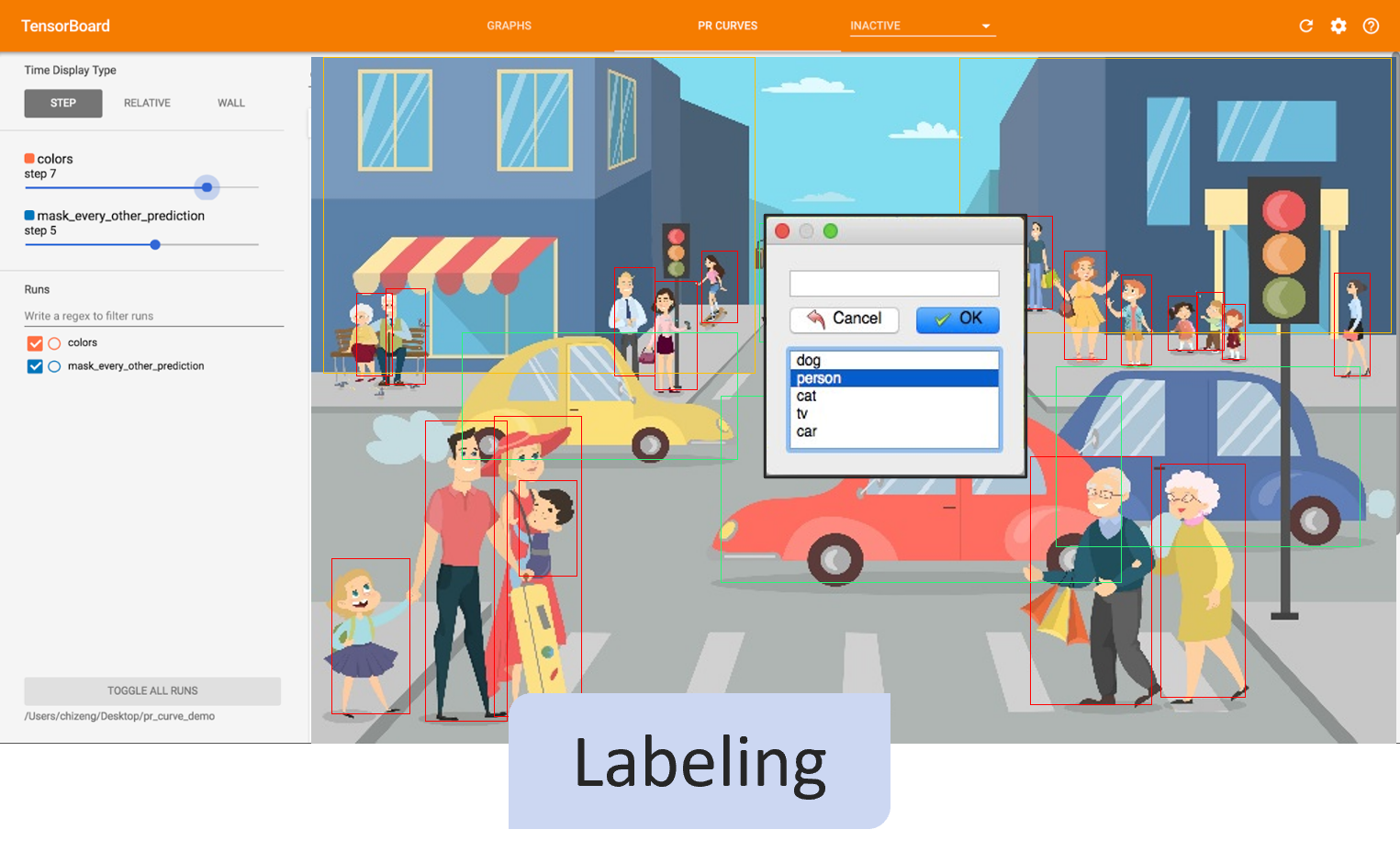

在這個階段,數據被賦予標籤或分類,這對於訓練機器學習模型至關重要。例如,圖像數據可能會被標記為包含特定對象或場景,而聲音數據可能會根據聲音種類進行標記,Sensor 的數據可能會根據指定的Sensor Raw Data 進行標記。這個過程通常需要人工完成,以確保數據的準確性和一致性。 |

|---|---|---|

|

步驟II |

|

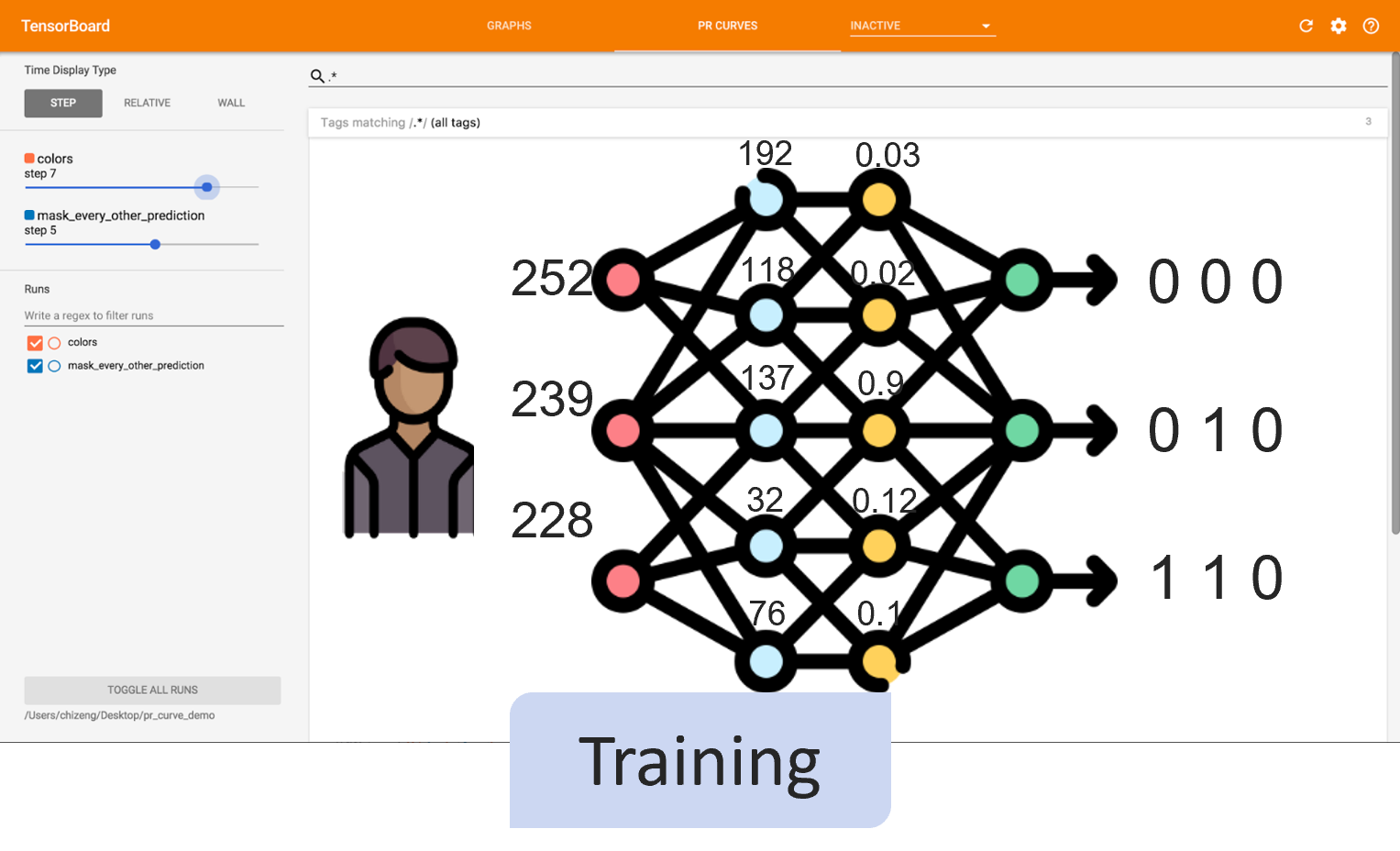

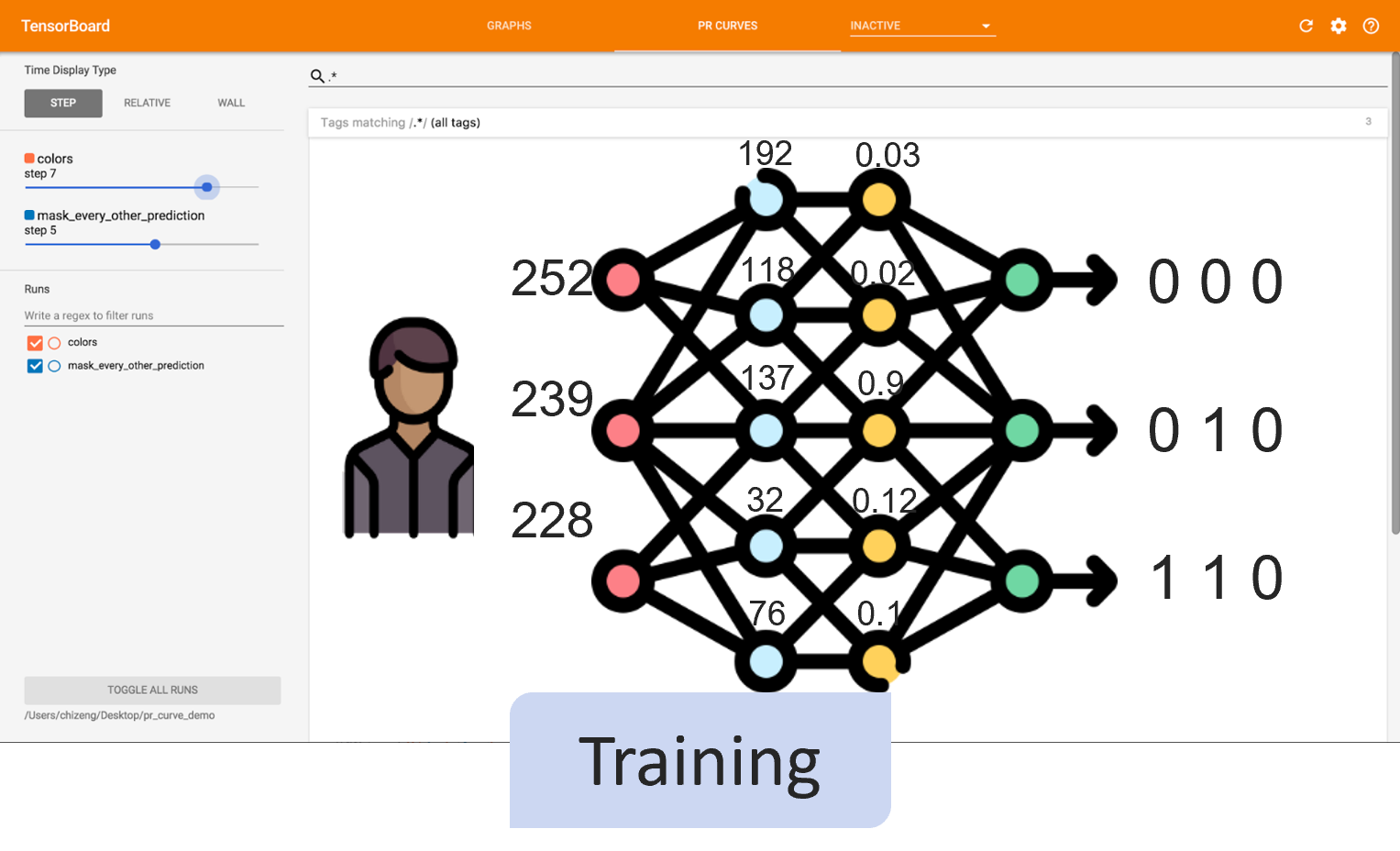

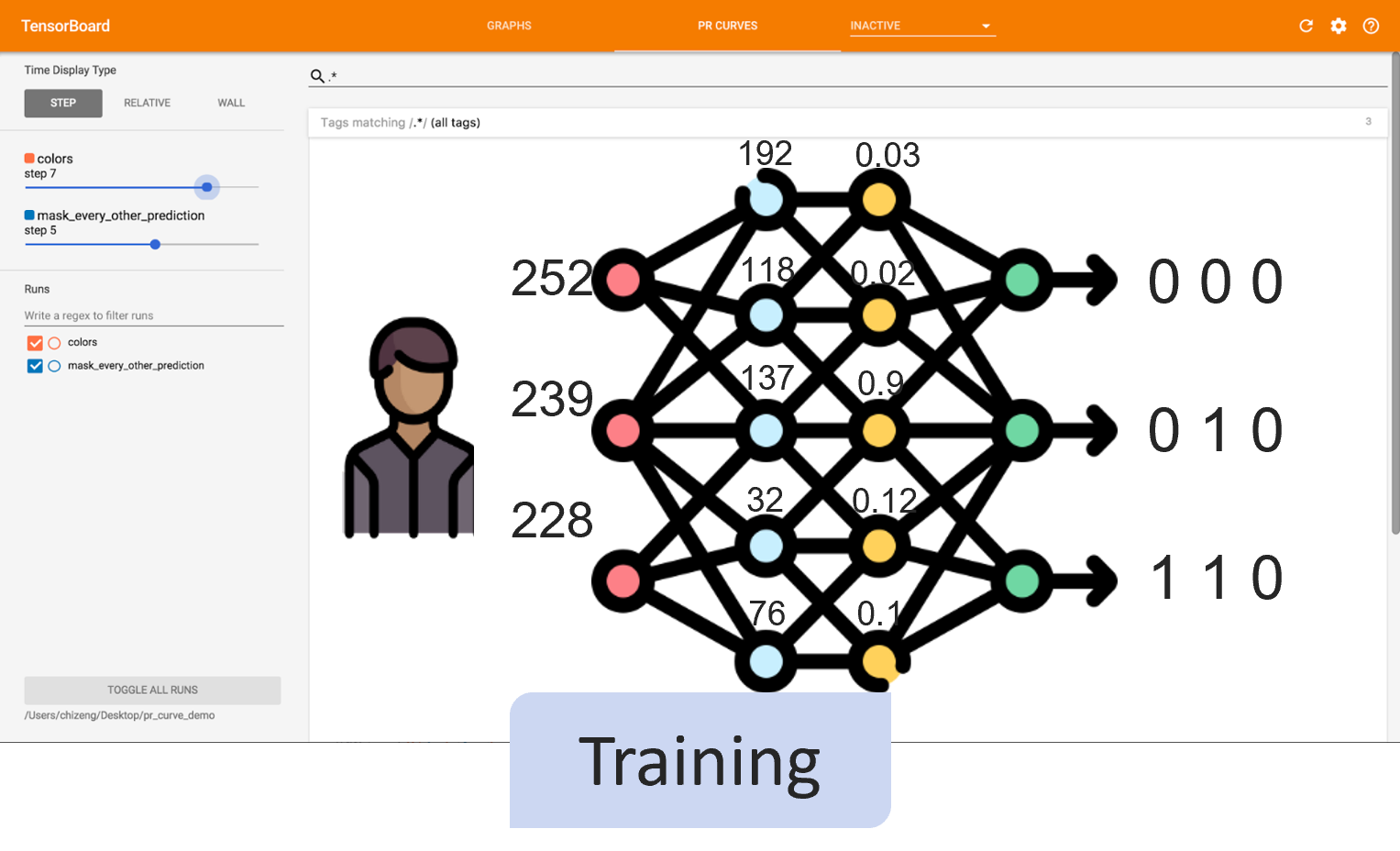

使用已標記的數據來訓練機器學習模型,此步驟Nuvoton也會提供預設的Model 使User 可以快速地訓練模型。訓練的模型以便能夠對未見過的數據進行預測或分類。訓練通常需要大量數據和計算資源。 |

|

步驟III |

|

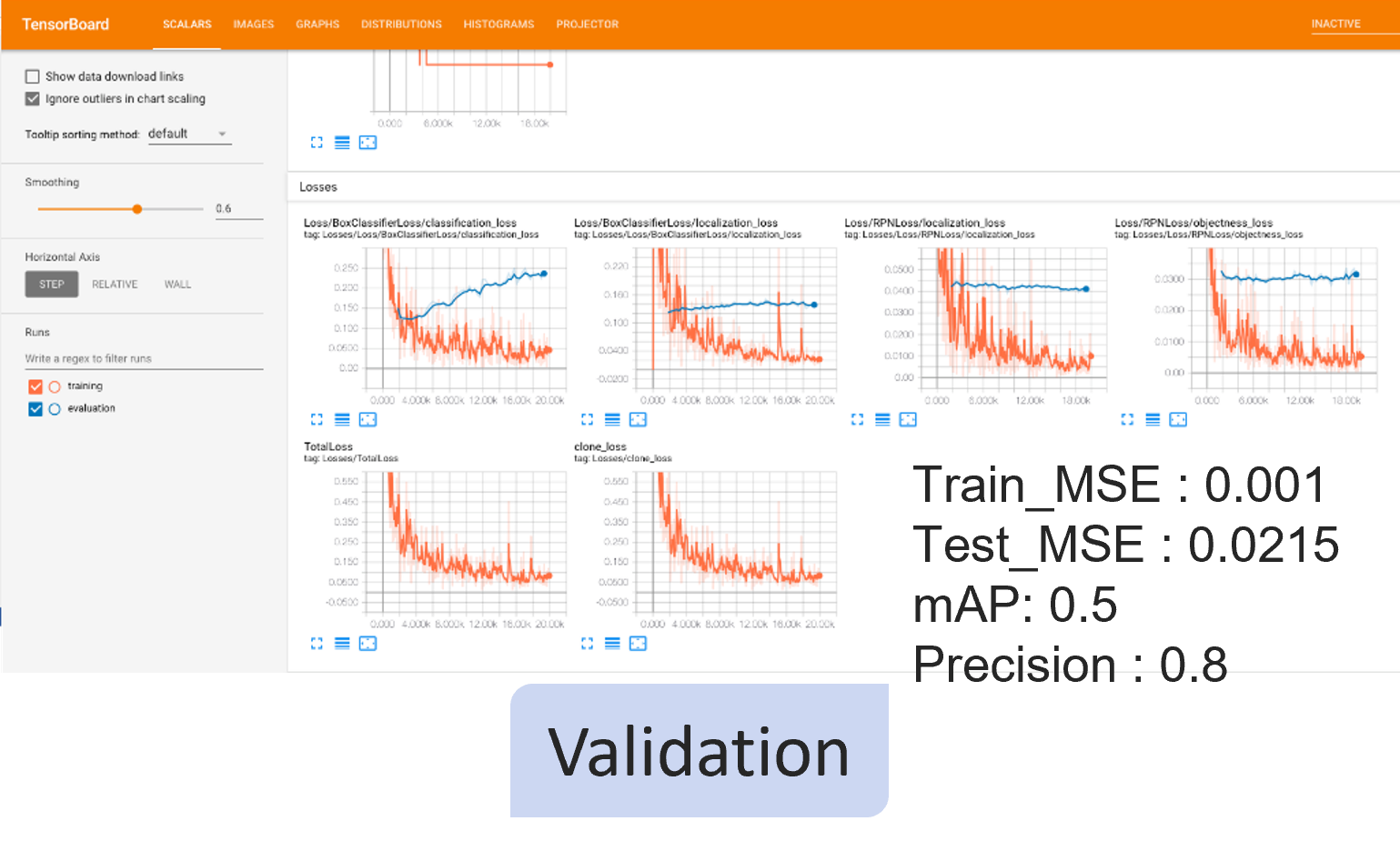

驗證階段是為了評估模型在未參與訓練過程的數據集上的表現。這可以幫助確定模型的準確度和泛化能力。通常會用一部分未用於訓練的數據來進行這一階段的評估。 |

|

步驟IV |

|

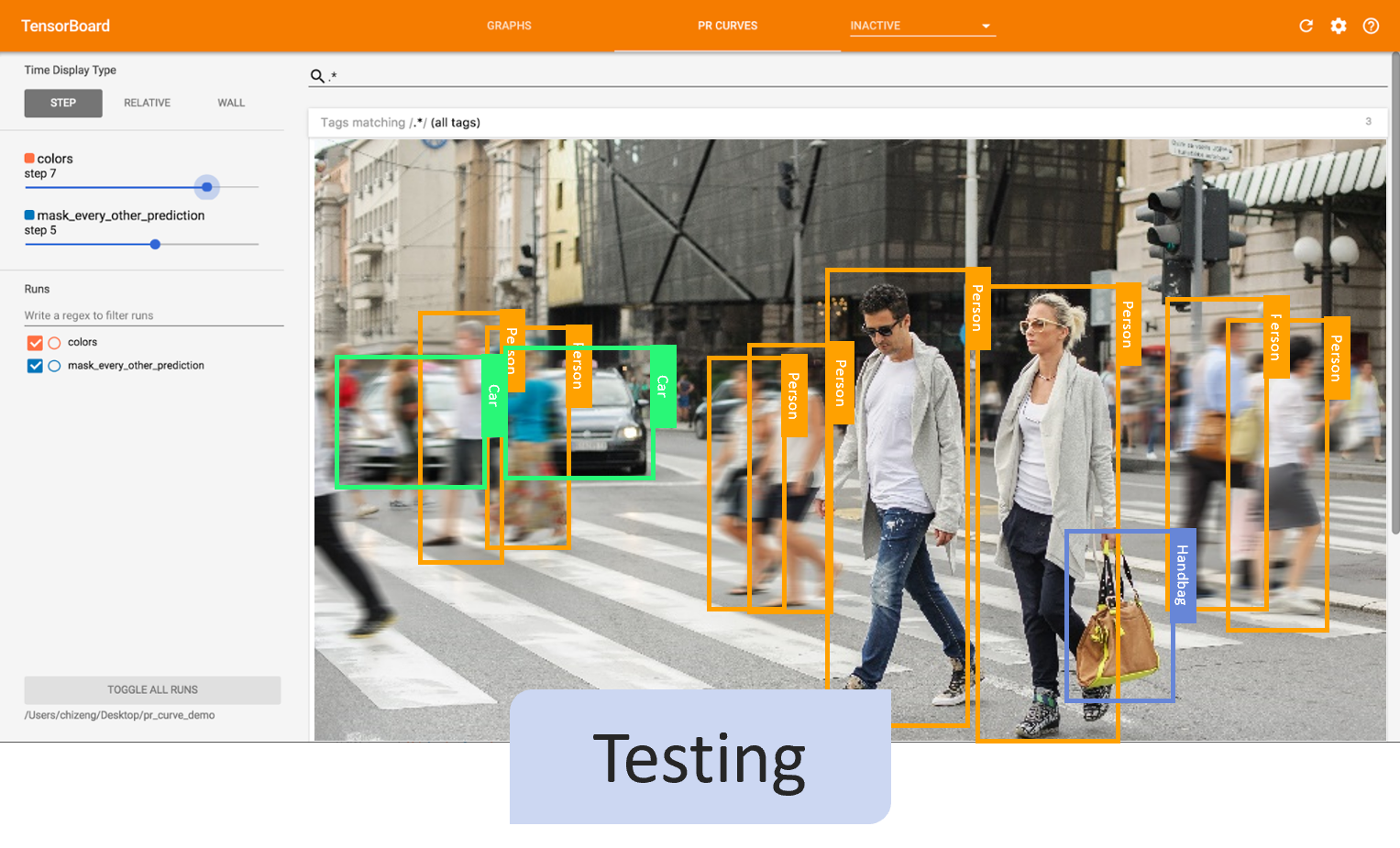

最後的測試階段進一步評估模型在完全獨立的數據集上的性能。這是檢查模型是否真正理解了數據特徵而不是僅僅記住訓練數據的關鍵步驟。成功的測試意味著模型準備好在現實世界中應用。 |

目前新唐科技已推出七種不同的開發場景,輕鬆跨出 AI 應用開發的第一步:

| 應用案例 | 模型 | 介紹 | 開發工具 | 適用 M467 | 適用 MA35D1 |

|---|---|---|---|---|---|

|

關鍵字辨識(Keyword Spotting) |

DNN/DS-CNN |

Small vocabulary(<=1秒)的關鍵字辨識 |

v |

|

|

|

手勢辨識(Gesture Recognition) |

CNN |

提供在各種手勢期間捕獲的三維加速度計讀數收集功能。 |

v |

|

|

|

影像分類(Image Classification) |

MobileNet |

運用遷移學習和微調技術、以 ImageNet dataset 訓練 MobileNet 模型。用戶可以根據自己的數據進一步訓練模型。 |

|

v |

|

|

物件偵測(Object Detection) |

SSD_MobileNet_fpnlite v2/v3 |

使用 TensorFlow Object Detection API,支援多種模型。若開發者希望嘗試SSD_MobileNet_fpnlite_v3,請使用TF1環境(詳情請參考鏈接)。 |

|

v |

|

|

物件偵測(Object Detection) |

Yolo-fastest v1 |

使用 DarkNet 訓練適用於邊緣運算的 YOLO 模型,提供將模型轉換為TensorFlow Lite 格式並使用 Vela 進行優化的功能。 |

|

v |

|

|

異常偵測(Anomaly Detection) |

DNN/Autoencoder |

實現 Tiny ML 模型訓練並將其轉換為TFLite格式,並在 EVK 上部署。 |

v |

|

|

|

視覺唤醒詞(Visual Wake Words) |

Small MobileNet RGB/gray |

著重於微控制器的視覺辨識應用,目標為識別圖像中是否存在人物(或其他感興趣的物件)。 |

v |

|

|

在這個階段,數據被賦予標籤或分類,這對於訓練機器學習模型至關重要。例如,圖像數據可能會被標記為包含特定對象或場景,而聲音數據可能會根據聲音種類進行標記,Sensor 的數據可能會根據指定的Sensor Raw Data 進行標記。這個過程通常需要人工完成,以確保數據的準確性和一致性。 |

使用已標記的數據來訓練機器學習模型,此步驟Nuvoton也會提供預設的Model 使User 可以快速地訓練模型。訓練的模型以便能夠對未見過的數據進行預測或分類。訓練通常需要大量數據和計算資源。 |

|

|

使用已標記的數據來訓練機器學習模型,此步驟Nuvoton也會提供預設的Model 使User 可以快速地訓練模型。訓練的模型以便能夠對未見過的數據進行預測或分類。訓練通常需要大量數據和計算資源。 |

使用已標記的數據來訓練機器學習模型,此步驟Nuvoton也會提供預設的Model 使User 可以快速地訓練模型。訓練的模型以便能夠對未見過的數據進行預測或分類。訓練通常需要大量數據和計算資源。 |

|